Cybathlon ビジョンアシスタント部門について

About Cybathlon Vision Assistance Descipline

Cybathlonとは,障害のある人々が最先端のサイボーグ技術を用いて競技を行う国際大会である.2024年は第3回目の開催となり,本大会より視覚障がい者を対象としたビジョンアシスタンス部門が追加される.我々のプロジェクトは,このビジョンアシスタンス部門に出場すべく日々研究開発活動に取り組んでいる.

WHOによると,全世界で22億人以上が視覚障害を抱えている.彼らは日常生活において視覚情報を取得することが困難であるため,移動やその他支援を他人に頼らなければならい場面が数多く存在する.そのことにより,彼らにとって生活の質と自立性の向上が重要な問題となっている.

現在AIやAR技術,GPSなどの技術の発展により,視覚障害者に対して多数の新しい選択肢を提供できる状況にある.実際それらを利用した支援器具がスマートフォンアプリやその他機器の形で提供されているが,それらの機能は一般的に特定領域(テキスト読み取りや色の読み取りなど)に限定されていることが多く,また便利で使いやすいものでないことが多い.

本活動を通して,視覚障害者支援技術の分野において研究開発を促進することで,彼らの生活の質と自立性の向上につながると考えられる.

Cybathlon is an international competition where challenged people compete using cyborg technology. Cybathlon 2024 is the 3rd edition of the competition and Vision Assistance Descipline is added as one of new deciplines. Our project is developing a new device for this decipline.

Recent year, the evolution of AI, AR, GPS and other technologies have made more new options for visually impaird people. Those technologies are being offered in various forms. However, they are not versatile enough.

We hope that our project will contribute to the improvement of their quality of life.

ビジョンアシスタンス部門のタスクについて

Tasks in Vision Assistance Descipline

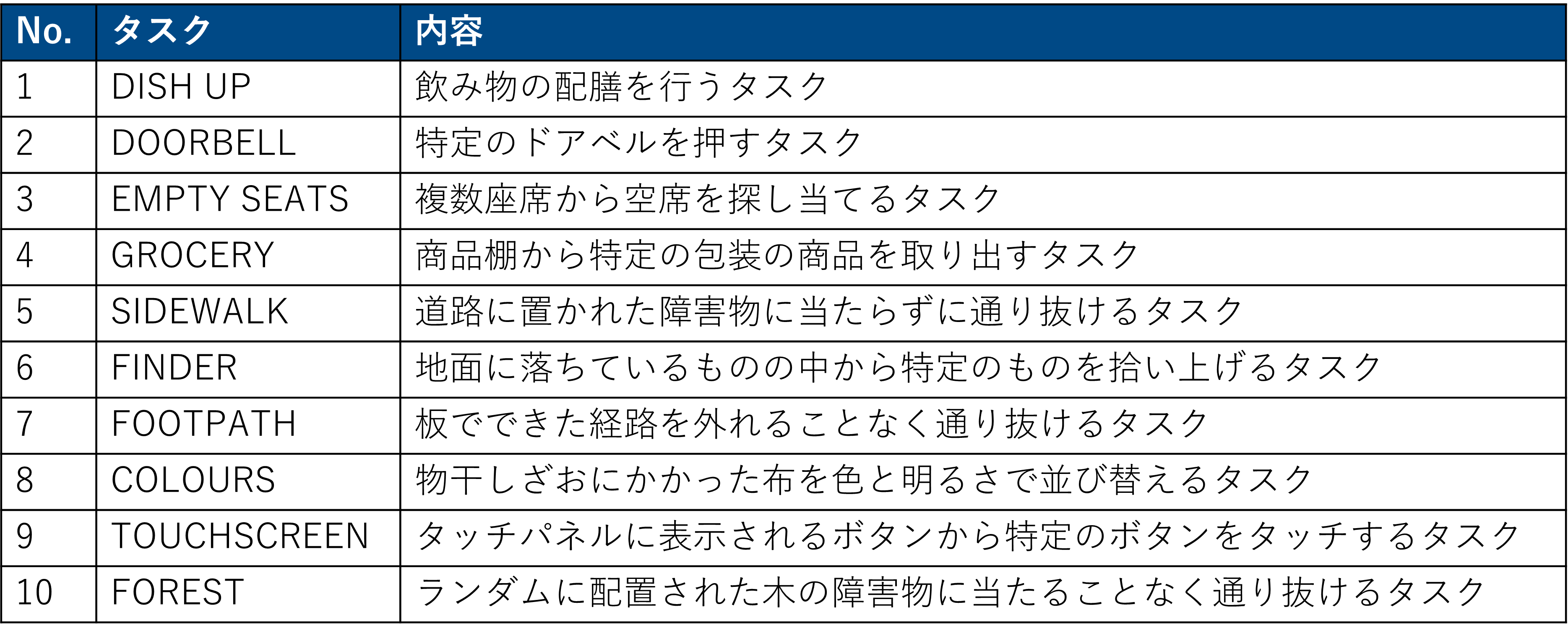

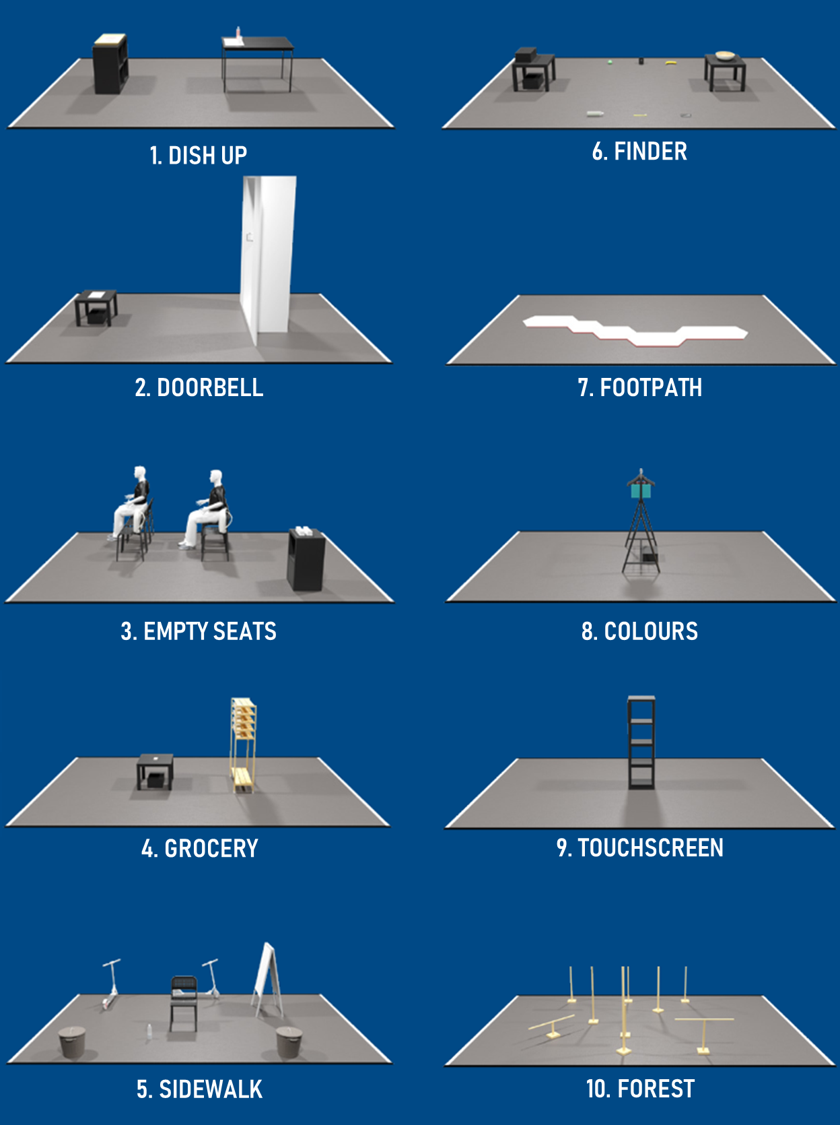

日常生活において視覚障がい者が遭遇する困難な状況を切り出してコースが設定されている.タスクの一覧は右の図に示すとおりである.各タスクについての説明は次の表に示すとおりである.

我々W-Visionsはこのうち,EMPTY SEATS,SIDEWALK,COLOURS,TOUCHSCREEN,FORESTの5つのタスクに取り組む.

It has 10 tasks that are made to reproduce difficult situations in daily life for visually impaird people. Ten tasks are shown in the right picture and the table with explanation is below.

We ,W-Visions, are going to challenge to the following 5 tasks :

EMPTY SEATS,SIDEWALK,COLOURS,TOUCHSCREEN,FOREST

各タスクをクリアするとそれぞれ一律10点が加算される.タスクを失敗する,もしくはスキップした場合は0点となり加算されない.

全てのタスクに取り組む制限時間は8分である.

We can get 10 points in each task. If the task is failed or skipped, we can't get any point for the task.

The pilot is required to finish all tasks in 8 minutes.

タスク一覧

W-Visionsの概要

About W-Visions

W-Visionsは和歌山大学サイバスロンプロジェクトのビジョンアシスタントチームの名前である.

2024年10月にスイスで開催されるサイバスロンビジョンアシスタンス部門への出場をめざし,日々活動に取り組んでいる.

W-Visions is the name of vision assistance team of Cybathlon project in Wakayama University.

We are developing a device for Cybathlon 2024.

Member

Team Manager:Shuro Nakajima

中嶋 秀朗

Team Pilot:Toko Momokitani

桃木谷 透孝

Yuma Kumano

熊野 有真

Master Student

[work]

- Forest

- Touch Screen

- SideWalk

W-Visionsのデバイスについて

About the Device of W-Visions

コンセプト - Concept

本システムのコンセプトについて説明する.

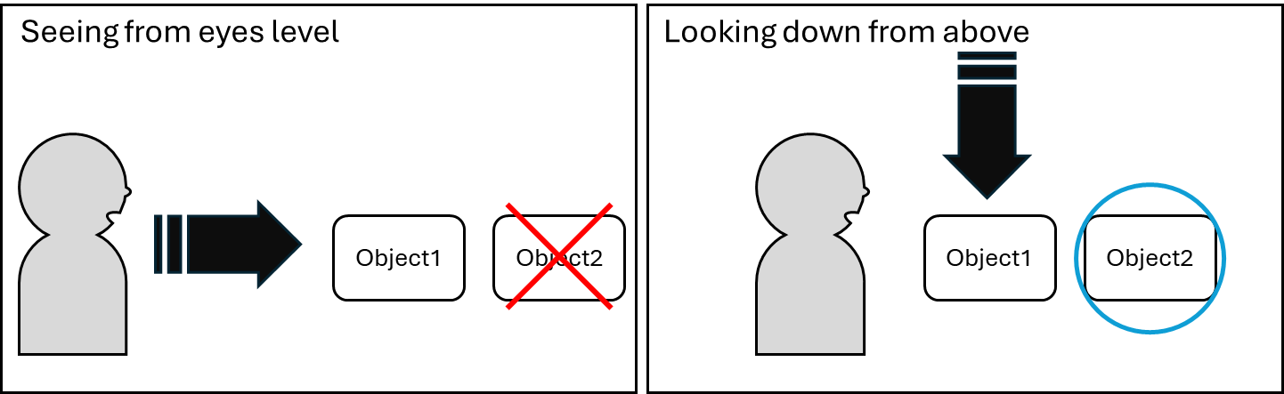

我々のチームは上からの俯瞰的な映像情報を利用することで効率的に周辺環境を把握することを目的としている.

目線の高さだと手前のものに隠れて奥のものを発見できないことがあるが,上からの視点を取得することによりそのような事態を防ぐことができる.

The purpose of our device is to get informations around the pilot efficiently by seeing from above.

When seeing from eyes level, soemtimes objects may obstruct the sight of the entire environment.

When lookig down from above, it can understand the entire environment at once.

コンセプト図

機器の持ち方 - How to hold the device

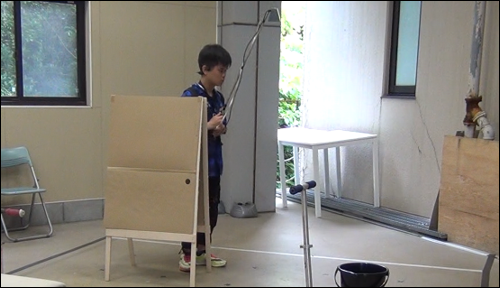

上から見下ろすため,棒の先端にカメラを取り付け,レンズを下に向ける.棒は写真のような姿勢を保つことで,パイロットの前方の環境を取得する.棒の持つ位置やカメラの角度を変更することでそのほかのタスクにも対応可能である.

A camera is attached to the tip of a stick and faced to the ground. This is the basic posture of the pilot. It can adapt to various tasks by changing the way to hold the device.

Empty Seats

高く掲げることで一度に全空席を把握

Raise the camera and capture the scene of all seats

SideWalk

上から見下ろし,前方を検知

Detect in front of the pilot from above

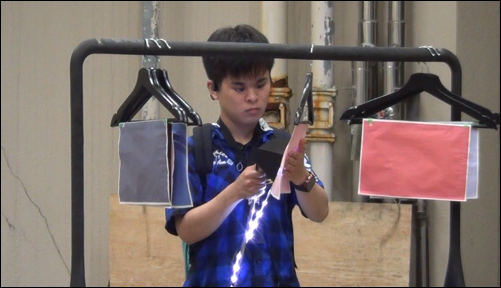

Colours

短く持ち,カメラカバーを布に押し当てる

Hold the stick short and press the ccamera against the fabric sheet

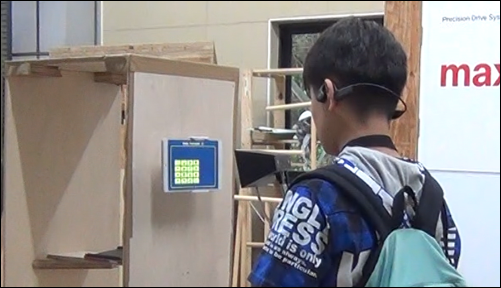

Touch Screen

短く持ち,カメラにタッチパネルを映す

Hold the stick short and capture the touch screen

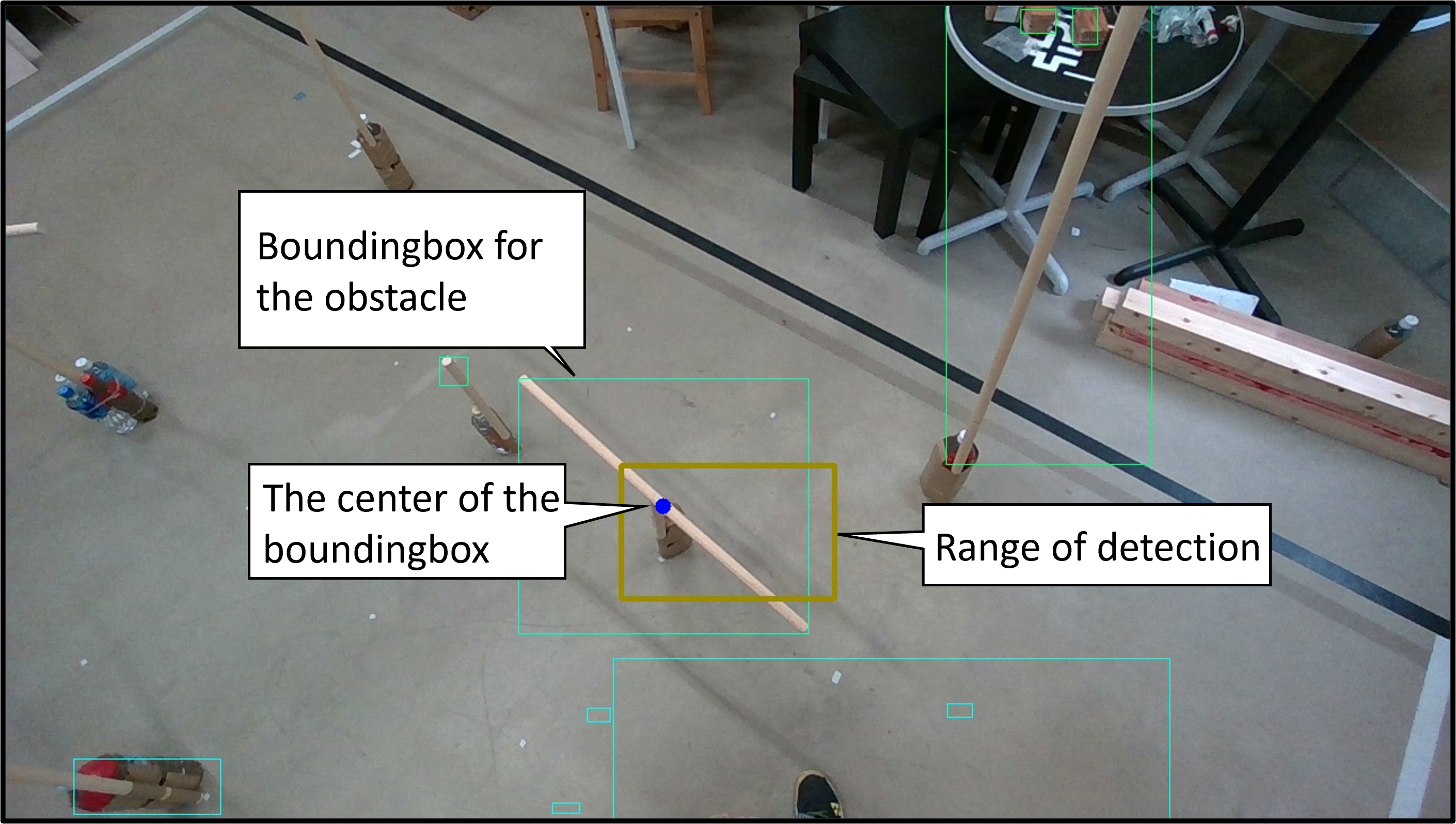

Forest

上から見下ろし,前方を検知

Detect in front of the pilot from above

システムが行っている処理について - The process of the system

使用するカメラはIntel RealSense D455であり,カラー画像と深度画像を併用して物体の検知や誘導などを行う.

操作はテンキーで行うことでシンプルさを実現している.

We use Intel RealSense D455 as the main sensor. The system utilizes both Color image and Depth image.

The system is operated through the input of numeric keyboard. This makes the user interface really simple.

Forestの障害物検出 - Detecting objects of Forest

深度情報と色情報により障害物を検出している

- Detecting objects by depth and color

- Playing the warning sound corresponding to the section in which the object is classified

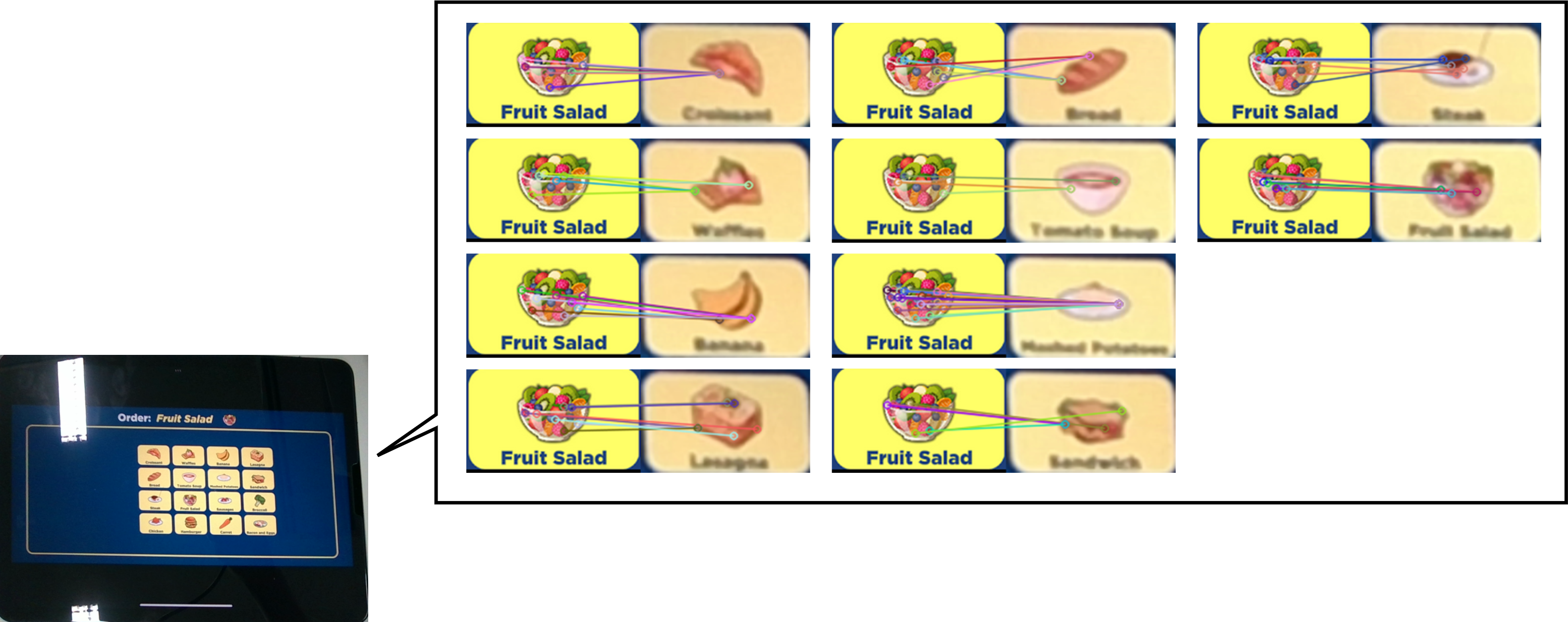

Touch Screenのfruit saladボタンの検出

すべてのボタンに対しfruit saladボタンとの類似度をAKAZE特徴量で計算する

最も類似度が高いボタンに指を誘導する

- Calculating similarity to fruit salad by AKAZE features

- Guiding the finger to the button which has the best similarity

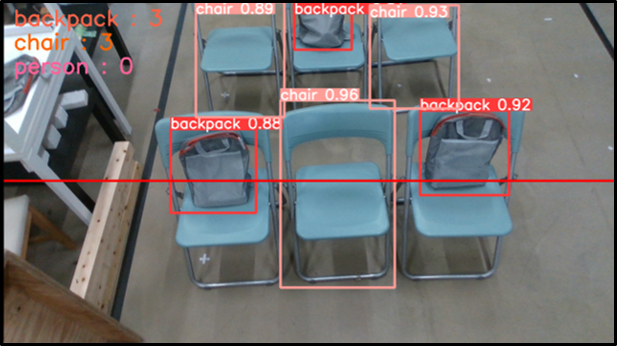

空席位置の検出

RGB画像からYOLOを用いて椅子,人,カバンを検出

物体の並びから空席位置を特定

- Detecting chair, person and backpack using YOLO

- Telling which seats are empty by the order of objects

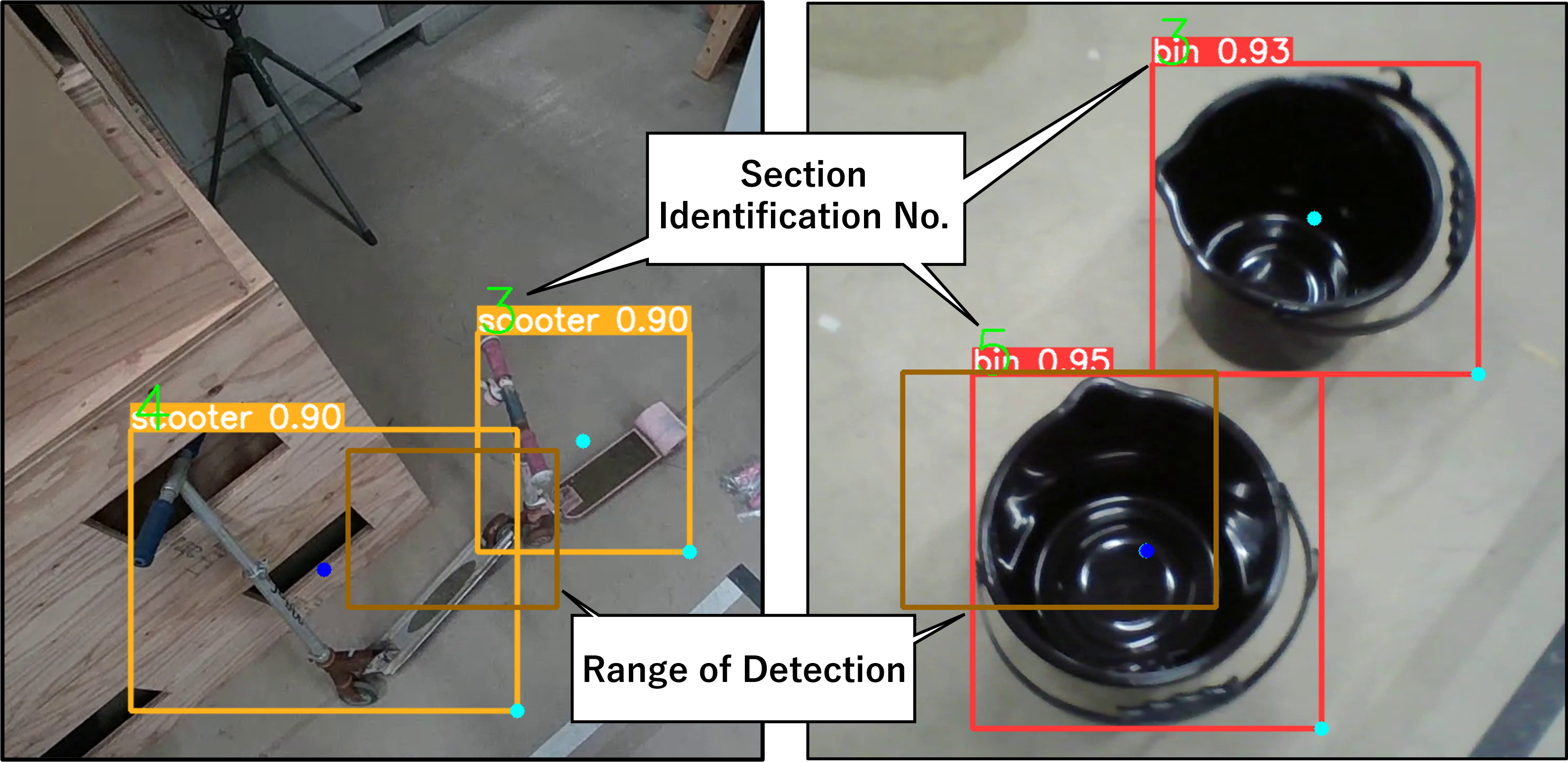

キックスクーターの検出

SideWalkの障害物であるキックスクーターとバケツをYOLOを用いて検出

パイロットから見た位置に応じた警告音を鳴らす

- Detecting kick scooters and bins using YOLO

- Playing the warning sound corresponding to the section in which the object is classified

布の色の検出

RGB画像から得た情報をCMYK情報に変換し,布の色を判別

カバーで外乱の影響を軽減

- Classifing the color of the fabric sheet with CMYK information converted from RGB information

- Reducing noise by the cover

Copyright © 2020 Wakayama University Cybathlon Project. All Rights Reserved.