研究テーマ

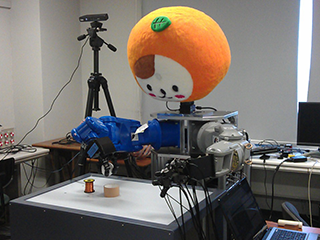

更新日 2019年7月18日2019年度オープンキャンパス(2019年7月14日)での遠隔操作デモの様子

研究テーマ

人間型ロボットの半自律遠隔操作 |

パワーアシストロボット |

その他 |

人間型ロボットの半自律遠隔操作

ロボットハードウェアの設計・開発

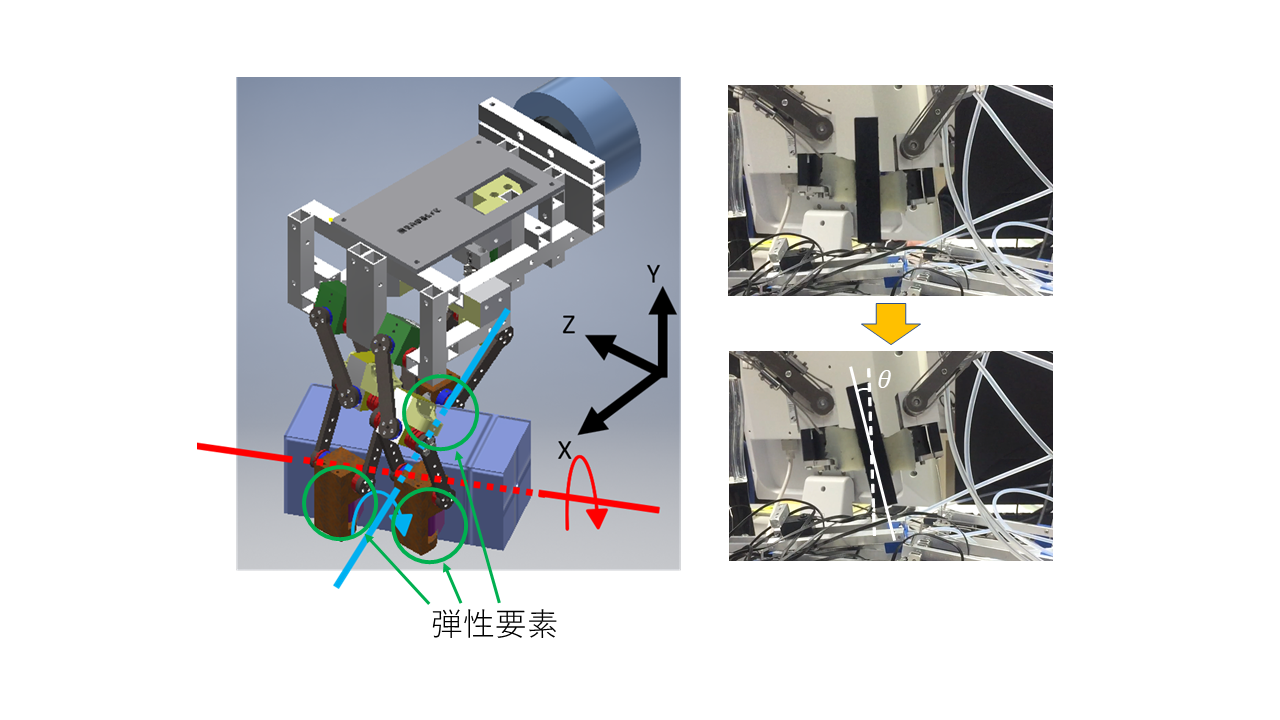

多指ハンドの開発

指先に配置した弾性要素の変形を利用して、少ない自由度で把持物体の6自由度運動を実現する多指ハンドを開発しています。

発表論文

- 和唐 昂希, 南方 隆秀, 小川原 光一, "弾性要素を利用して把持物体の6自由度運動を実現する多指ロボットハンドの開発," 日本機械学会 関西学生会2018年度学生員卒業研究発表講演会, 12P13, 2018.

ロボットの動作計画技術の開発

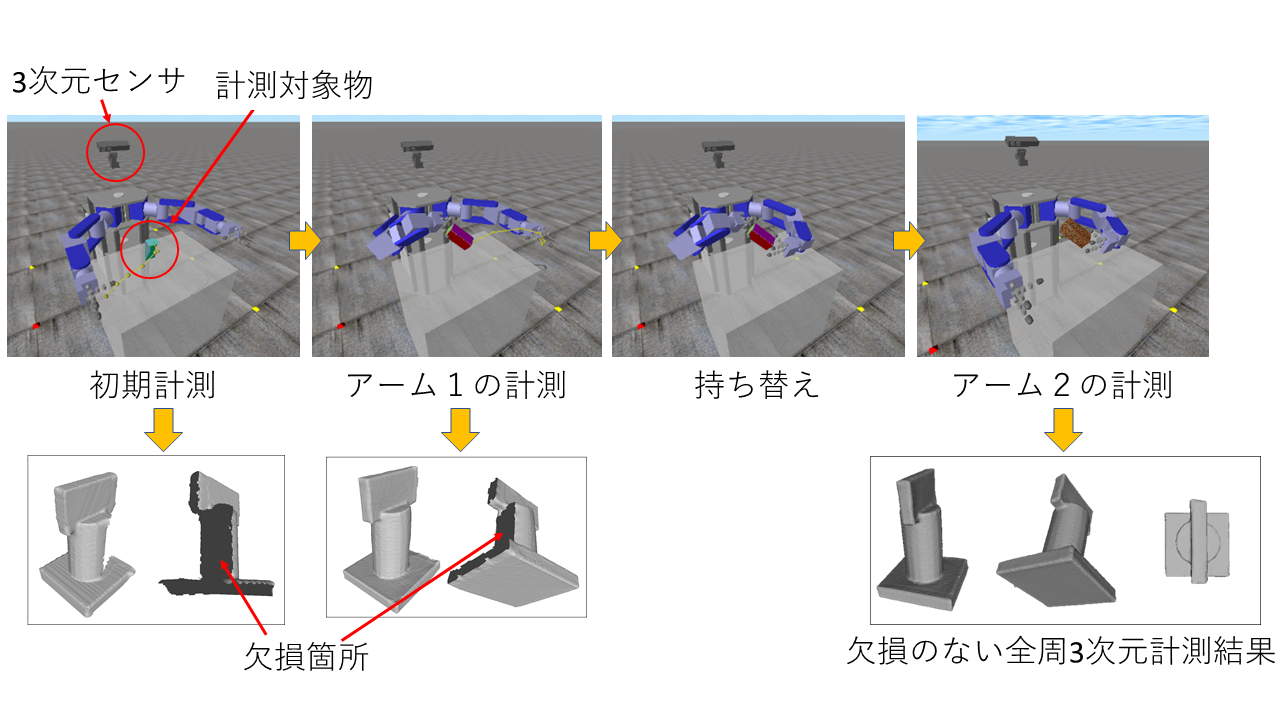

持ち替えを利用した3次元計測

2台のロボットアーム・ハンドによる持ち替えを利用して、RGB-Dセンサにより物体の全周3次元形状を自動計測するアルゴリズムを開発しています。

発表論文

- 原田 稜, 小川原 光一, "RGB-Dカメラと双腕ロボットによる把持の可否を考慮した持ち替えに基づく全周3次元形状計測法の開発," 第19回計測自動制御学会システムインテグレーション部門講演会(SI)予稿集, 3D2-08, pp.2986-2990, 2018. (大阪)

- 齋藤 拓史, 小川原 光一, "連続多様体からなる物体の把持姿勢候補を用いた RRT-connect に基づくロボットの把持計画法," 第18回計測自動制御学会システムインテグレーション部門講演会(SI)予稿集, 3A4-10, pp.2182-2186, 2017. (宮城)

- 塔本 健太, 小川原 光一, "把持の安定性を考慮したRRT-connect に基づく多指ハンドとロボットアームの経路探索法," 第18回計測自動制御学会システムインテグレーション部門講演会(SI)予稿集, 3A4-04, pp.2155-2158, 2017. (宮城)

遠隔操作者への映像提示技術の開発

発表論文

- 岩橋 知久, 小川原 光一, "遠隔操作のための複数3次元視覚情報統合・提示システムの開発~過去の映像の提示による作業対象の視認性の向上~," 第19回計測自動制御学会システムインテグレーション部門講演会(SI)予稿集, 2C1-05, pp.1675-1679, 2018. (大阪)

深層学習に基づく認識技術の開発

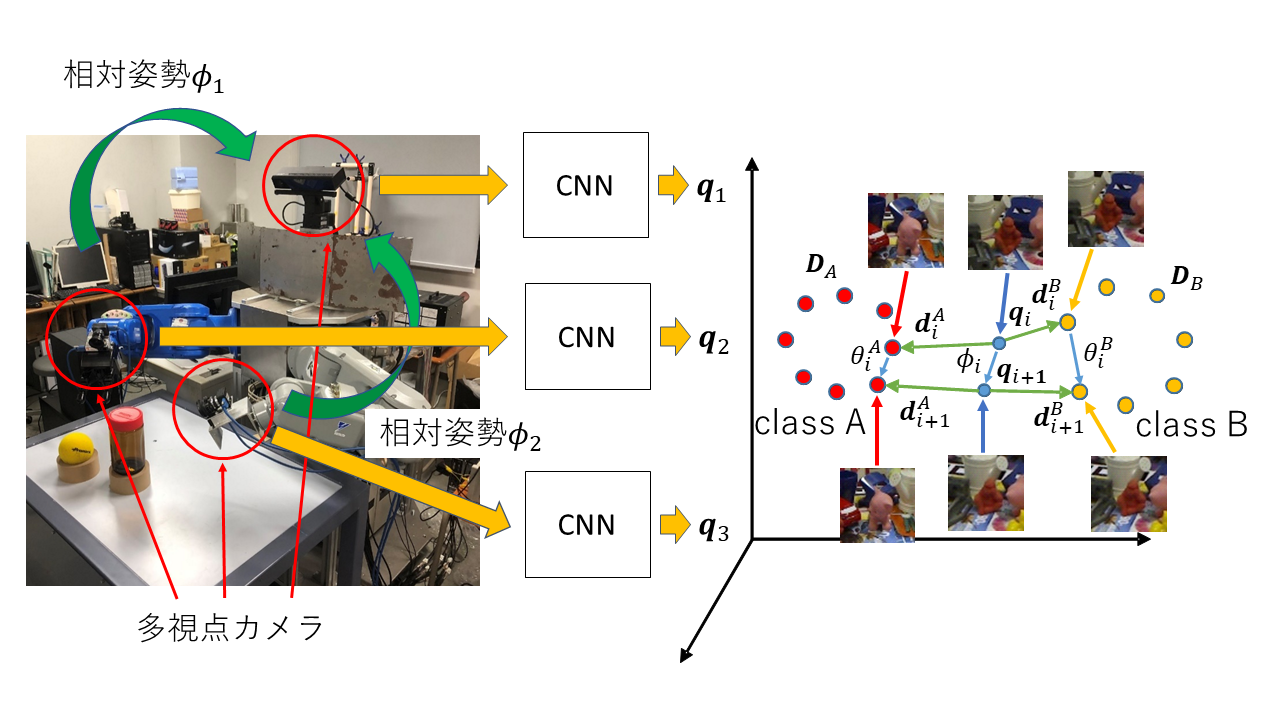

剛体の認識技術

多視点画像(ロボットの頭部と左右の腕部に搭載されたカメラ画像)と既知のカメラ間の相対姿勢の情報を入力とし、多層ニューラルネットを利用した物体認識と姿勢推定技術を開発しています。

発表論文

- Koichi Ogawara, Keita Iseki, "Estimation of object class and orientation from multiple viewpoints and relative camera orientation constraints," Proc. IEEE/RSJ 2020 International Conference on Intelligent Robots and Systems (IROS), pp.10588-10594, Oct. 2020. DOI: 10.1109/IROS45743.2020.9340771

- 井堰 啓太, 小川原 光一, "多視点から得られるRGB-D画像とカメラの姿勢を用いた深層学習に基づく物体の種類と姿勢の推定," 第19回計測自動制御学会システムインテグレーション部門講演会(SI)予稿集, 3D2-09, pp.2991-2994, 2018. (大阪)

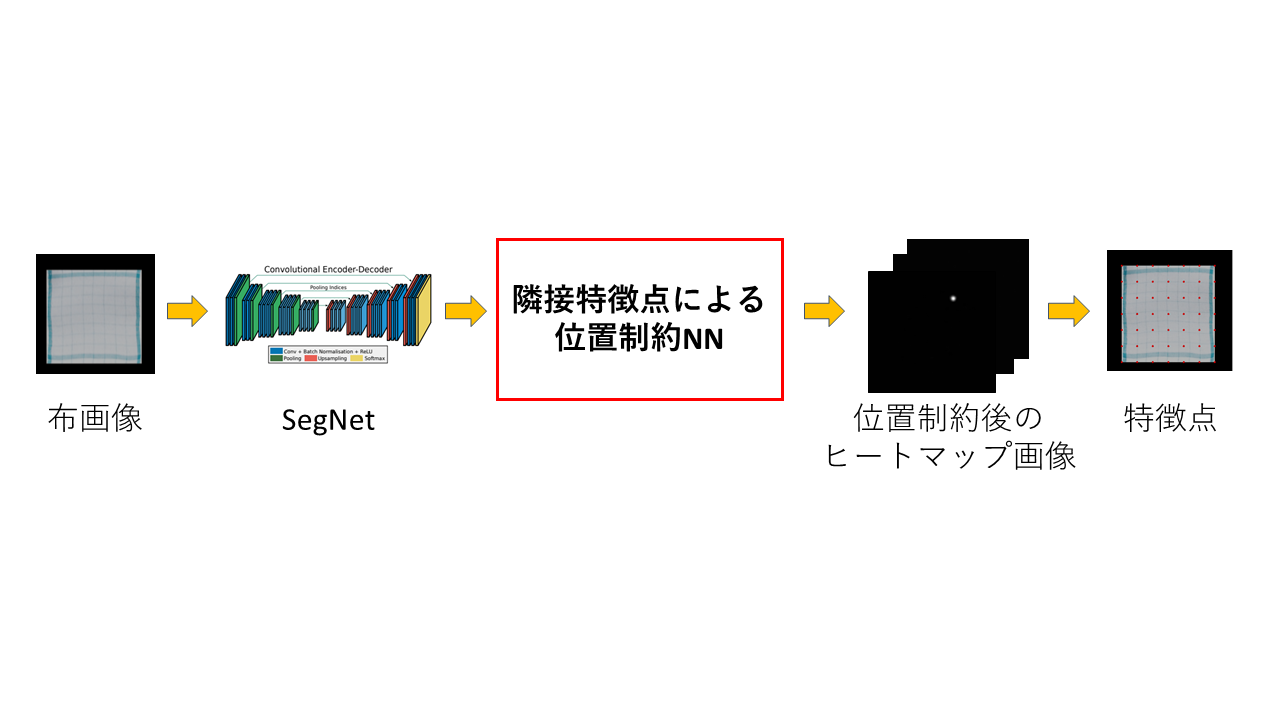

柔軟物の認識技術

多層ニューラルネットを利用して、テーブルの上に乱雑に置かれた長方形布の形状推定技術を開発しています。

発表論文

- Daiki Sonegawa, Koichi Ogawara, "Segmentation and Shape Estimation of Multiple Deformed Cloths\\Using a CNN-Based Landmark Detector and Clustering," Proc. 2022 IEEE International Conference on Robotics and Automation (ICRA), pp.xxxx-xxxx, 2022. (Philadelphia, USA)

- 曽根川 大輝, 小川原 光一, "深層学習に基づく複数の長方形布の分離と形状推定," 第22回計測自動制御学会システムインテグレーション部門講演会 講演論文集, 2B2-14, pp.1397-1402, 2021.12 (鹿児島)

- 今川 涼介, 小川原 光一, "隣接特徴点の位置制約を用いた深層学習に基づく任意に変形した長方形布の形状推定," 第19回計測自動制御学会システムインテグレーション部門講演会(SI)予稿集, 3D2-05, pp.2970-2975, 2018. (大阪)

パワーアシストロボット

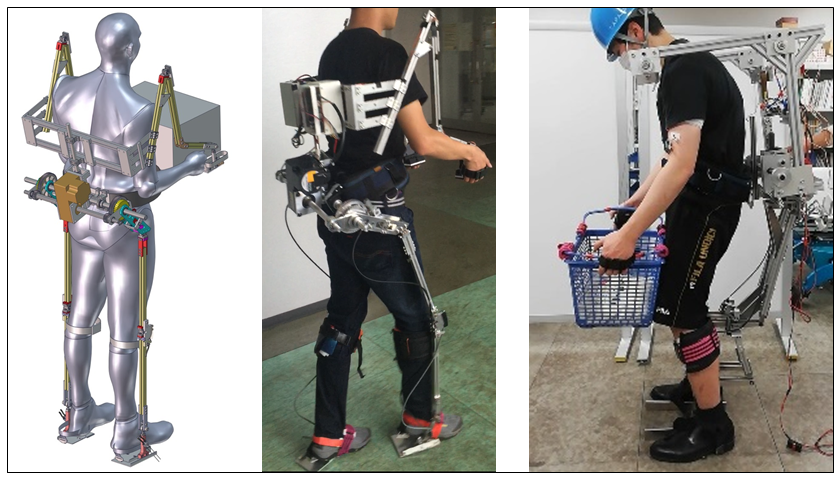

重量物運搬支援パワーアシストスーツ 2017-

1台のモータで全身の負担を軽減することが可能な重量物運搬支援パワーアシストスーツを開発しています。脚機構が装着者の足の内側に収まるようになっており、ウィンチ機構により荷物を昇降します。また、多様な荷物を把持できるように形状が可変な持ち手を開発しています。

発表論文

- 坪井 和広, 原 亨成, 小川原 光一, 鈴木 新, 菊地 邦友, "装着者の脚の内側に配置したリンク機構により重量物の支持運搬を支援するパワーアシストスーツの開発," ロボティクス・メカトロニクス講演会2019, 1P1-I03, pp.1-4, 2019. (広島)

- 原 亨成, 坪井 和広, 小川原 光一, 鈴木 新, 菊地 邦友, "線形な荷物の昇降動作と非線形な膝の固定・解放動作を両立するパワーアシストスーツ用ワイヤ駆動機構の開発," ロボティクス・メカトロニクス講演会2019, 1P1-I09, pp.1-4, 2019. (広島)

- 堀口 皓生, 小川原 光一, 鈴木 新, 菊地 邦友, "直動部と回転部から構成されるラチェット機構を用いたパワーアシストスーツの持ち手の開発," ロボティクス・メカトロニクス講演会2019, 1A1-I10, pp.1-4, 2019. (広島)

重量物運搬支援パワーアシストスーツ

重量物(20Kg程度)の運搬を支援する装着型のパワーアシストスーツを開発しています(特許出願済).以下の動画では,モータ1台で,重量物の昇降,重量物を支持した状態での歩行を実現するパワーアシストスーツのデモを行っています.

2号機の荷物(5Kg)運搬動作実験(2015年3月27日)

ビジネス・エンカレッジ・フェア2014 でのデモンストレーション

発表論文

- Tomoya Takeno, Ayano Murakami, Han Peng, Koichi Ogawara, Arata Suzuki, Kunitomo Kikuchi, "Development of Power Assist Suit for Supporting and Transporting Heavy Objects with Single Motor", The 34th Chinese Control Conference and SICE Annual Conference 2015.

- 韓 鵬, 武野 友哉, 村上 綺乃, 小川原 光一, 鈴木 新, 菊池 邦友, "クレーン型アームを有し1台のモータで重量物の支持運搬を補助するパワーアシストスーツの開発", 第59回システム制御情報学会研究発表講演会 (SCI'15)予稿集, 341-2, pp.1-4, 2015. (大阪)

- 武野 友哉, 村上 綺乃, 韓 鵬, 小川原 光一, 鈴木 新, 菊池 邦友, "装着者と一致する腰と脚の関節軸を有し1台のモータで重量物の支持運搬を補助するパワーアシストスーツの開発", ロボティクス・メカトロニクス講演会2015予稿集, 2P1-M01, pp.1-3, 2015. (京都)

その他

実時間ビジョン

本研究では,ノードの出力メッセージをそのノードの全出力メッセージの平均値で置き換え,さらに低解像度グラフから元のグラフへと階層的にメッセージを伝播することにより,画像に対して適用した場合に通常の確率伝播法と比較して計算時間を約2分の1から3分の1に,メモリ使用量を40%に削減可能な近似確率伝播法を提案しています.また,提案手法を CPU および GPU 上に実装し,Middlebury ステレオデータセットを使用して通常の確率伝播法と比較実験を行い,わずかな精度の低下と引き換えに計算時間とメモリ使用量の両面において性能が大きく改善されたことを示しました.

発表論文

- 小川原 光一, "階層的な出力メッセージの平均化に基づく近似確率伝搬法," 電子情報通信学会論文誌, Vol. J94-D, No. 3, pp. 593-603, 2011.3

- Koichi Ogawara, "Approximate Belief Propagation by Hierarchical Averaging of Outgoing Messages," Proc. 20th Int. Conf. on Pattern Recognition (ICPR), pp.1368-1372, Aug. 2010. (Istanbul, Turkey) (Oral presentation)

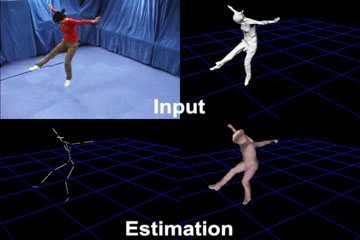

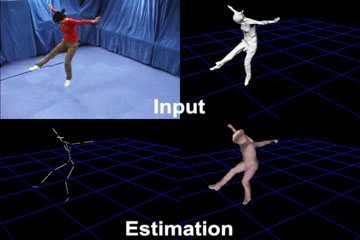

マーカレスモーションキャプチャ

本研究では,マーカレスモーションキャプチャの一手法として,多視点からの時系列ビデオ画像から輪郭情報を利用して対象の三次元復元を行い,これと人体の三次元形状モデルとの位置合わせを行うことによって,人間の全身運動を連続推定する手法を提案しています.

本手法の特長は以下の2点です。

- 関節構造を持った人体の柔軟変形モデルを用いることによって肩の複雑な動きや腰のひねりなど繊細な動きに追従することができます。

- 階層的 ICP とロバスト推定を組み合わせ、また対応点探索を工夫することによって、腕と胴の相互干渉や誤復元および激しい運動に対して頑健な推定を可能にします。

発表論文

- Koichi Ogawara, Xiaolu Li, Katsushi Ikeuchi, "Marker-less Human Motion Estimation using Articulated Deformable Model" Proc. IEEE Int. Conf. on Robotics and Automation (ICRA), pp. 46-51, Apr. 2007. (Rome, Italy). Best Vision Paper Award

- 小川原 光一, 李 暁路, 池内 克史, "関節構造を持つ柔軟変形モデルを用いた人体運動の推定," 画像の認識・理解シンポジウム(MIRU)予稿集, pp.994-999, Jul. 2006. (仙台)

時系列データ解析

高頻度パターン抽出

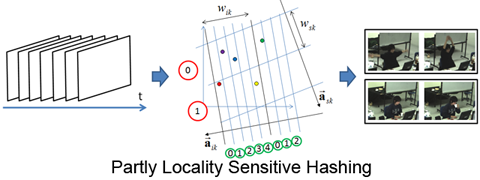

観測データ中に高頻度で出現する時系列パターンは,教師無しで未知の事象を学習するための手がかりとして有用です.本研究では,近似最近傍探索の枠組みを利用して,画像列から効率よく未知の高頻度パターンを抽出する手法を提案します.提案手法の特長は,Partly Locality Sensitive Hashing (PLSH) を用いて各時刻ごとに近傍の類似パターンを効率よくサンプリングする点と,動的計画法によって全画像列から計算量 O(N^{1+1/a}) (Nは画像数)で高頻度パターンを求める点の2点です.また,起立など日常よく現れる複数の全身運動を抽出・分離する実験において提案手法の有効性を確認しました.

発表論文

- 小川原 光一, 田邉 康史, 倉爪 亮, 長谷川 勉, "Partly Locality Sensitive Hashing を用いた時系列データからの高頻度パターン抽出," 日本ロボット学会誌, Vol. 29, No. 1, pp. 67-76, 2011.1

- Koichi Ogawara, Yasufumi Tanabe, Ryo Kurazume, Tsutomu Hasegawa, "Detecting Frequent Patterns in Video using Partly Locality Sensitive Hashing," Proc. the 2nd International Workshop on Video Event Categorization, Tagging and Retrieval in conjunction with ACCV 2010, WS4-P06, pp.1-10, Nov. 2010. (Queenstown, New Zealand)

ロボットの動作学習

人間行動観察学習ロボット

人間の行うお手本動作の観察に基づいてロボットが新たな動作を獲得するための方法を研究しています。これまでに、絵画の描画、ひも結び、把持遷移の認識、隠れマルコフモデルによる物体操作の認識と再生などに取り組みました。

発表論文

- Shunsuke Kudoh, Koichi Ogawara, Miti Ruchanurucks, Katsushi Ikeuchi, "Painting robot with multi-fingered hands and stereo vision", Robotics and Autonomous Systems, Vol. 57, No. 3, pp.279-288, 2009.3

- Jun Takamatsu, Koichi Ogawara, Hiroshi Kimura, Katsushi Ikeuchi, "Recognizing Assembly Tasks Through Human Demonstration", Int. Journal of Robotics Research, Vol.26, No.7, pp.641-659, 2007.7

- Keni Bernardin, Koichi Ogawara, Katsushi Ikeuchi, Ruediger Dillmann, "A Sensor Fusion Approach for Recognizing Continuous Human Grasping Sequences Using Hidden Markov Models," IEEE Transactions on Robotics, Vol. 21, No. 1, pp 47-57, 2005.2

- Koichi Ogawara, Jun Takamatsu, Hiroshi Kimura, Katsushi Ikeuchi, "Modeling Manipulation Interactions by Hidden Markov Models," Proc. IEEE/RSJ 2002 Int. Conf. on Intelligent Robot and Systems (IROS), pp.1096-1101, Oct. 2002. (Lausanne, Switzerland)

視線運動からの意図推定

準備中

発表論文

- Kenji Sakita, Koichi Ogawara, Shinji Murakami, Kentaro Kawamura, Katsushi Ikeuchi, " Flexible Cooperation between Human and Robot by interpreting Human Intention from Gaze Information," Proc. IEEE/RSJ Int. Conf. on Intelligent Robot and Systems (IROS), pp.846-851, Oct. 2004. (仙台)

- 崎田 健二, 小川原 光一, 木村 浩, 池内 克史, "視線を用いた人間の意図推定に基づく人間とロボットの柔軟な協調作業," 画像の認識・理解シンポジウム(MIRU)予稿集, pp.475-480, Jul. 2004. (函館)

ITS (Intelligent Transportation System)

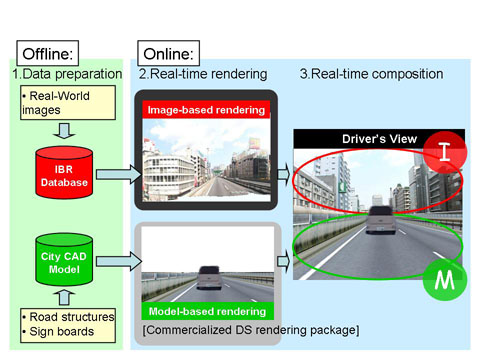

本プロジェクトでは、遠景の描画には実写画像を用い、近景および他車の描画にはCGを用いて、これらを違和感無く実時間で合成することにより、非常に現実感の高いドライビングシミュレータの表示技術を開発します。

本研究では、実写画像を元に OpenGL を使用して遠景映像を実時間で生成する技術を開発し、同時に既成のドライビングシミュレータからの近景出力と実時間で合成するシステムを開発しました。

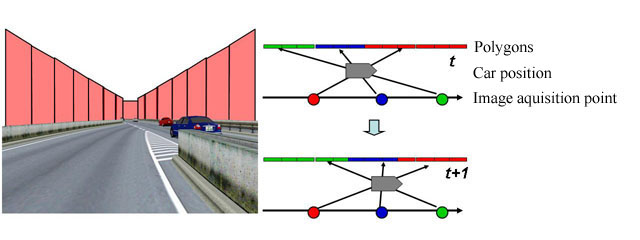

- CGで描画される道路の両側にポリゴンの壁を並べ、計測車で収集した時系列全方位画像DBから自車の位置からの見えに応じた適切な画像パッチを切り出し、各ポリゴンにテクスチャマップします

- 各ポリゴンのテクスチャは、自車の位置が変わるごとに30fpsで動的に切り替わります

発表論文

- Koichi Ogawara, Shintaro Ono, Masataka Kagesawa, Hiroshi Kawasaki, Katsushi Ikeuchi, "Real-image based driving view synthesizing system for innovative traffic evperiment space," Proc. IEEE/RSJ Int. Conf. on Intelligent Robots and Systems(IROS), 2006. (Beijing, China).

- Shintaro Ono, Koichi Ogawara, Masataka Kagesawa, Hiroshi Kawasaki, Keiichi Kenmotsu, Mayumi Sakai, Motomu Tsuji, Katsushi Ikeuchi, "Image generation system for mixed-reality traffic experiment space," Proc. 11th World Congress on Intelligent Transort Systems and Services (ITSWC), Oct. 2004. (名古屋)